人体动态智能解码引擎:全栈式体育视觉技术中枢

White Paper: Human Motion Intelligent Decoding Engine

一、 执行摘要 (Executive Summary)

从像素到决策:重新定义人体运动的数字化标准

“人体动态智能解码引擎”是一套全栈式机器视觉解决方案,旨在解决体育与健康领域中非接触式数据采集难、分析门槛高、反馈滞后的核心痛点。我们将连续、复杂的视频像素流压缩为可度量、可计算的“行为代码(Behavior Code)”。这套系统打破了实验室与应用场景的边界,让教练、医生与科研人员能够摆脱昂贵的专业设备束缚,仅凭单目或多目摄像头即可获取医疗级精度的运动学数据。

全闭环技术中枢:打通“感知—认知—行动”数据流

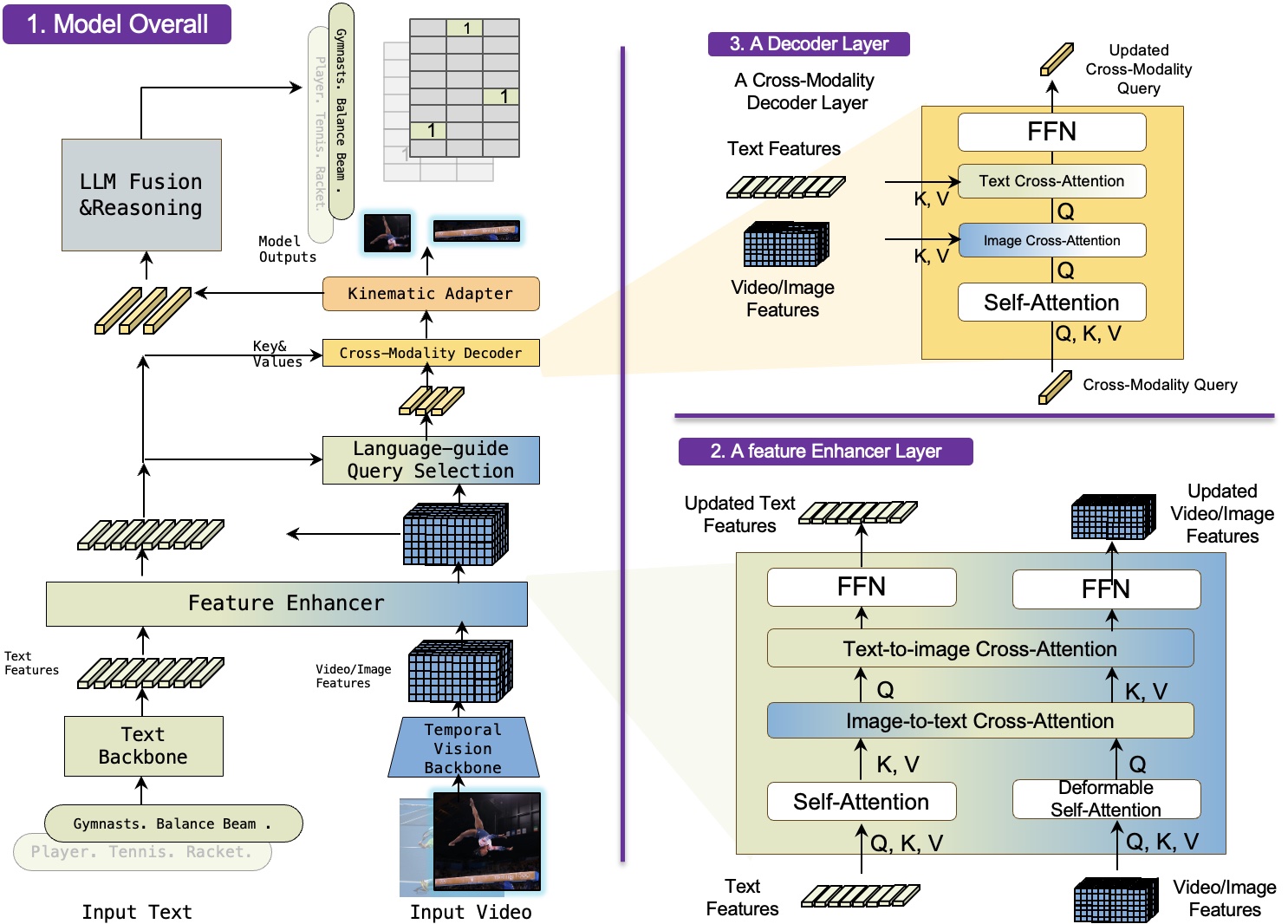

作为一站式技术中枢,本引擎覆盖了从底层感知到上层决策的完整链条。在感知层,我们实现了从RGB视频/传感器数据采集、高精度3D姿态重建到动作时序定位的自动化;在认知层,结合大语言模型(LLM)与RAG技术,将冷冰冰的数据转化为自然语言的战术分析、康复评估与训练处方。系统支持从“动作捕捉”到“战术量化”,从“术后监测”到“数字人驱动”的训练—评估—优化全闭环。

多维场景赋能:按需定制的行业级落地

基于多模态融合、少样本自适应与边缘实时推理技术,本引擎已具备极强的行业延展性。我们不仅服务于竞技体育(青训评分、精英队技战术分析),更深入健康医疗(步态诊断、跌倒预警)、影视工业(无标记动捕)及智能硬件(AR训练辅助)等领域。无论是云端的大数据挖掘,还是嵌入式芯片上的毫秒级推理,我们致力于为每一个垂直场景提供高精度、高鲁棒性且商业可行的智能化解决方案。

二、 核心价值与产品定位 (Value Proposition)

1. 端到端全栈闭环 (End-to-End Full Stack Capability)

拒绝碎片化拼凑,提供交钥匙级别的系统能力。 我们不只提供单一的算法SDK,而是交付一套从数据源头到决策终端的完整生态。

对于开发者:提供从自动化标注工具、模型训练管线到多平台部署(Python SDK/C++引擎)的完整工具链。

对于终端用户:直接输出可视化的教练仪表盘、医疗级康复报告与交互式3D战术沙盘,实现“录入即分析,分析即决策”。

2. 实验室级精度,边缘侧速度 (Lab-Grade Precision at Edge Speed)

在消费级硬件上实现专业级性能,平衡精度与时效。

极致性能:深度优化的推理引擎支持在Jetson Orin、骁龙8 Gen3等边缘计算平台上实现60FPS+的实时推理,满足体育训练即时反馈与比赛现场分析的严苛低延迟要求。

高保真还原:通过多模态融合(RGB+IMU+力台)与时序优化算法,在无标记点(Markerless)条件下,实现媲美光学动捕系统的关节角度与生物力学参数估计。

3. 从“感知”跃升至“认知” (From Perception to Cognition)

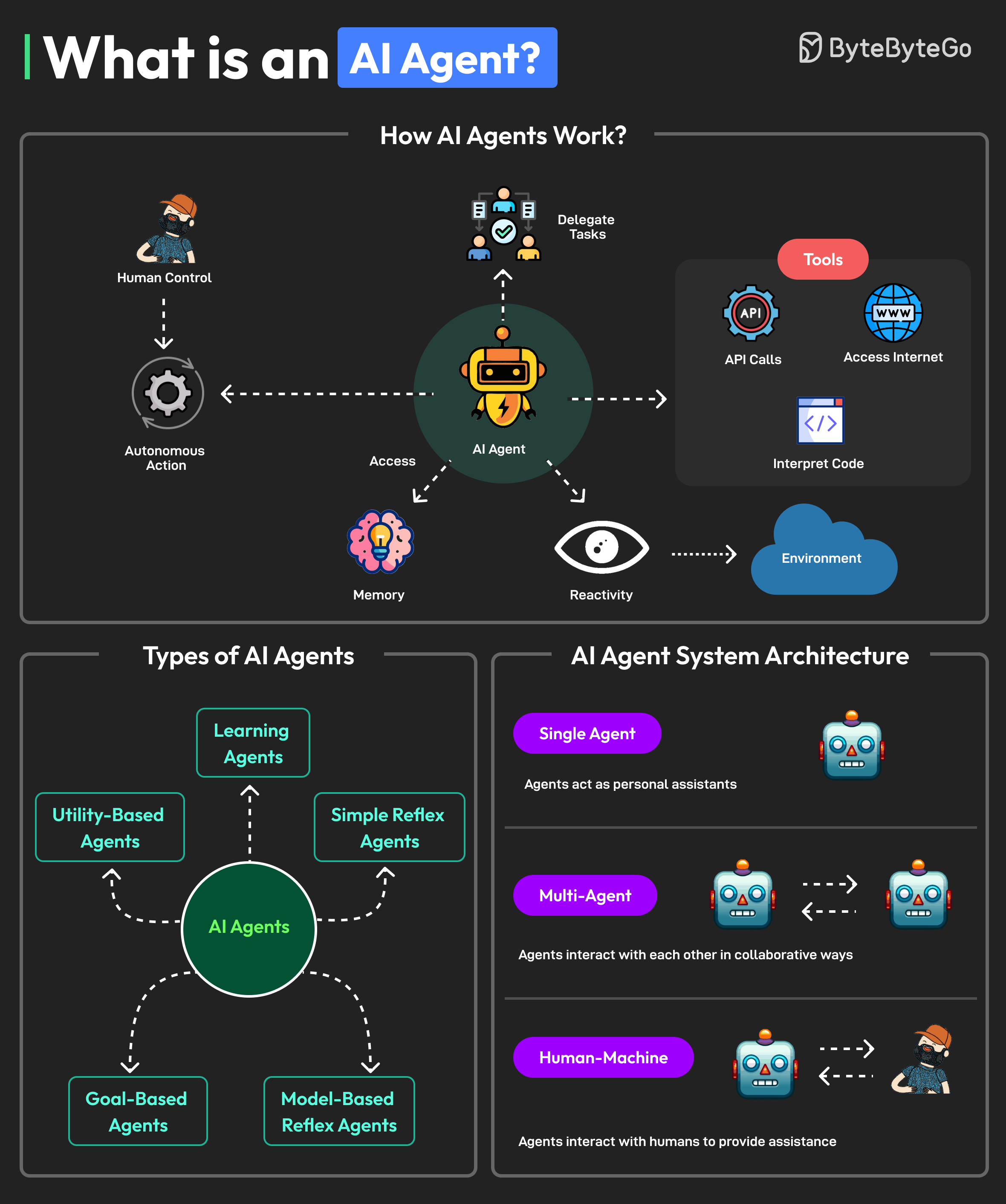

不止于看清动作,更在于理解意图。 这是我们区别于传统CV方案的核心壁垒。我们将计算机视觉与大语言模型(LLM)、知识图谱(KG)与智能体(Agent)体系深度融合。

语义级交互:用户不再面对枯燥的数据表格,而是可以通过自然语言查询“为什么发球效率下降?”或“生成针对膝盖内扣的训练计划”。

知识服务化:将行业专家的经验(规则、战术、病理)数字化为“行为代码”与知识库,使AI具备像人类专家一样的推理、归因与建议能力。

4. 敏捷适配与商业化弹性 (Agile Adaptation & Scalability)

极低的定制门槛,快速响应多变的行业需求。

少样本/零样本适配:依托元学习(Meta-Learning)与动作编码器技术,仅需少量样本即可快速适配新动作(如新武术套路)或新运动项目,大幅降低算法定制成本与周期。

灵活交付模式:支持多样化的商业落地形态,包括SaaS订阅服务、软硬一体化工作站、嵌入式SDK授权以及面向消费级APP的轻量化集成,覆盖B端专业市场与C端大众市场。

三、 核心技术架构 (Core Technology Architecture)

本引擎采用分层解耦的模块化设计,自下而上构建了从物理世界感知到数字世界决策的全栈技术体系。通过“多模态感知—行为量化解码—认知决策辅助”的三级火箭架构,实现体育视觉技术的闭环落地。

1. 基础感知与数字孪生层 (Perception & Digital Twin Layer)

负责将物理世界的非结构化数据(视频、传感器信号)转化为高精度的三维数字化结构。

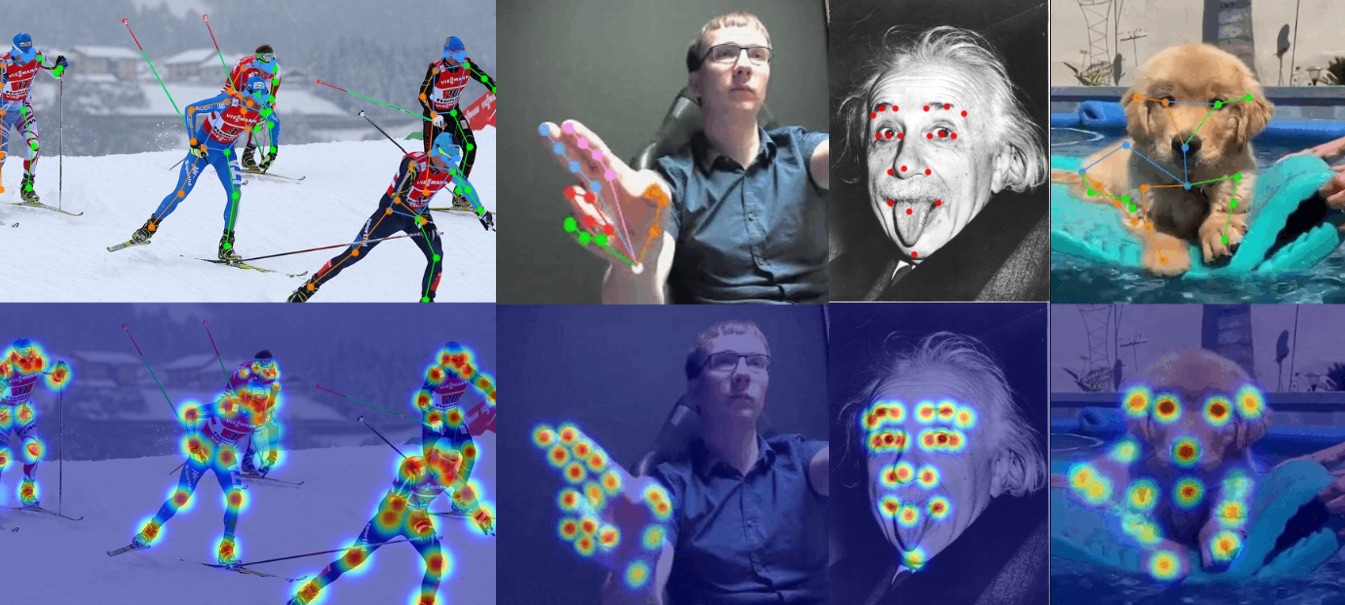

全场景姿态估计 (Omni-Pose Estimation):

多粒度捕捉:集成OpenPose、RTMPose与自研轻量化模型,支持从单人到密集人群(Crowd)的关键点检测。不仅覆盖身体骨骼,更扩展至手部(21点)、面部微表情及足部压力分布解析。

高保真3D重建:基于SMPL/SMPL-X人体参数化模型,结合3D姿态估计和三维重建算法,在无标记点(Markerless)环境下实现从2D视频到3D Mesh的实时重建,还原人体肌肉形变与骨骼旋转。

多模态融合感知 (Multimodal Fusion):

异构数据对齐:通过时空特征对齐技术,将视觉(RGB)、惯性传感器(IMU)、力台(Force Plate)与表面肌电(sEMG)数据融合,构建包含运动学与动力学信息的完整“数字孪生体”。

环境与物体交互:同步重建球类轨迹(如网球旋转/弹道)、器械状态(如球拍、单车)及场地边界,实现“人-物-场”的统一空间建模。

2. 动作理解与行为解码层 (Understanding & Decoding Layer)

负责将数字化的人体结构压缩为可计算、可检索的“行为代码 (Behavior Code)”。

细粒度动作解析 (Fine-grained Action Analysis):

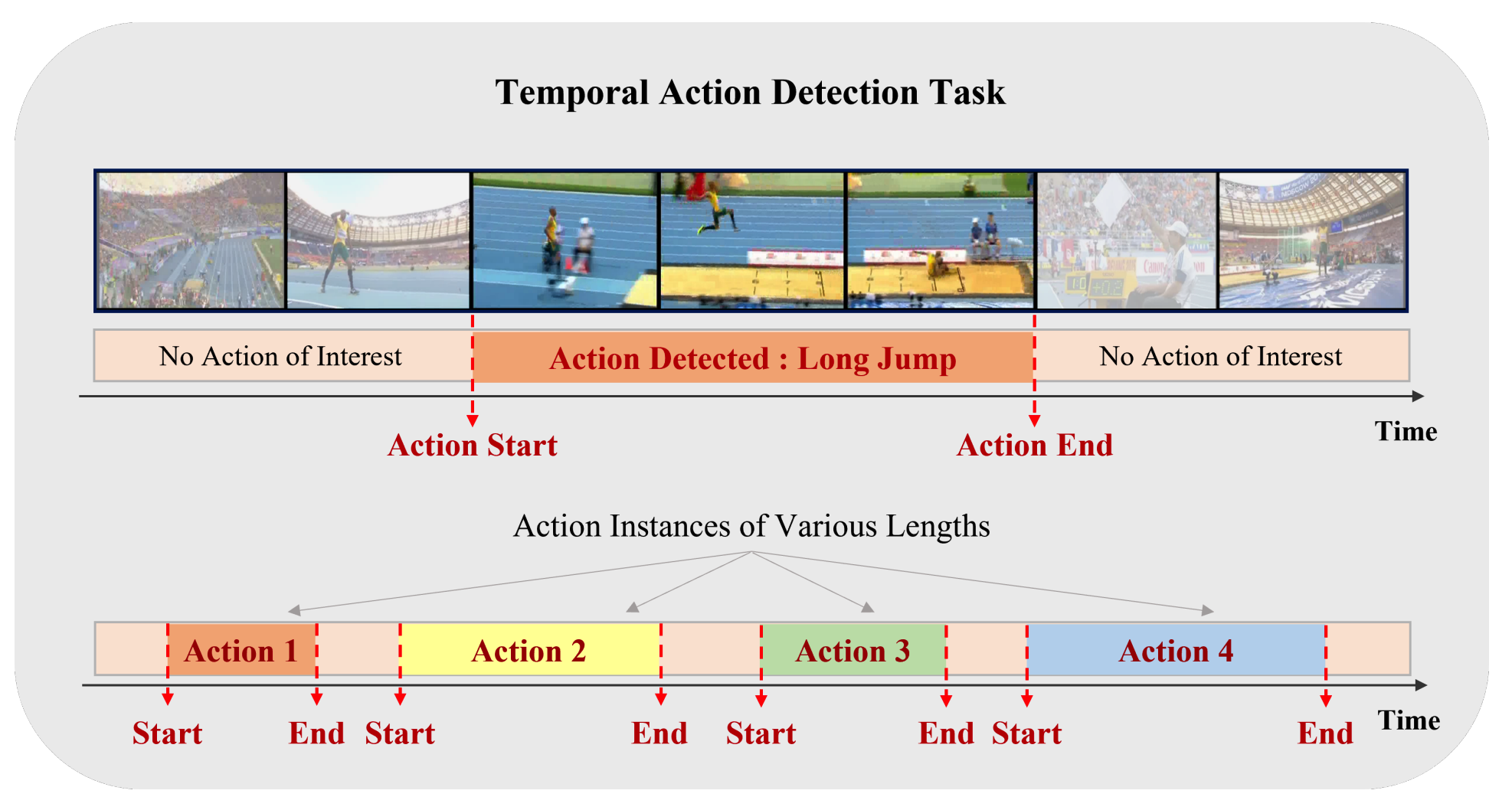

时序行为定位:利用时序动作检测算法框架,精确切分动作的起止点(如起跳瞬间、触球时刻),时间精度达到帧级。

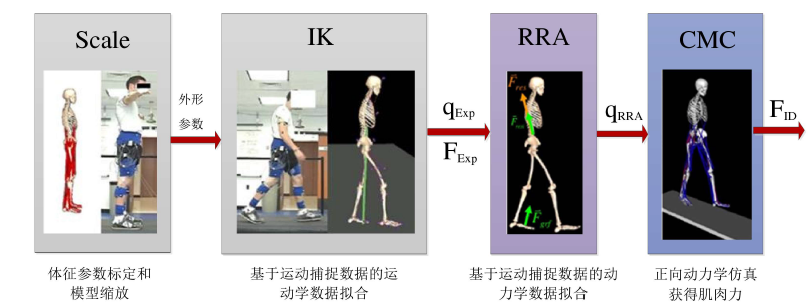

生物力学量化:内置逆动力学解算引擎,自动计算关节角速度、地面反作用力(GRF)估算值、肌肉群激活度及运动链能量传递效率,将视觉图像转化为多项专业运动学指标。

行为编码器 (Behavior Encoder):

离散化表征:将无限连续的动作序列映射到有限的符号空间,生成“行为代码”。这使得复杂的体育动作可以像文本一样被索引、比对和计算。

异常与模式识别:基于无监督学习与时空图卷积网络(ST-GCN),自动识别异常步态、违规动作或特定的战术跑位模式。

3. 认知智能与决策Agent层 (Cognition & Agent Layer)

负责将结构化数据转化为自然语言建议、战术洞察与训练处方。

体育垂类大模型体系 (Sports-LLM & RAG):

检索增强生成 (RAG):构建包含运动医学论文、专家规则库、历史比赛数据的向量数据库。当用户提问时,系统能精准检索相关“行为代码”与专业知识,生成有理有据的回答。

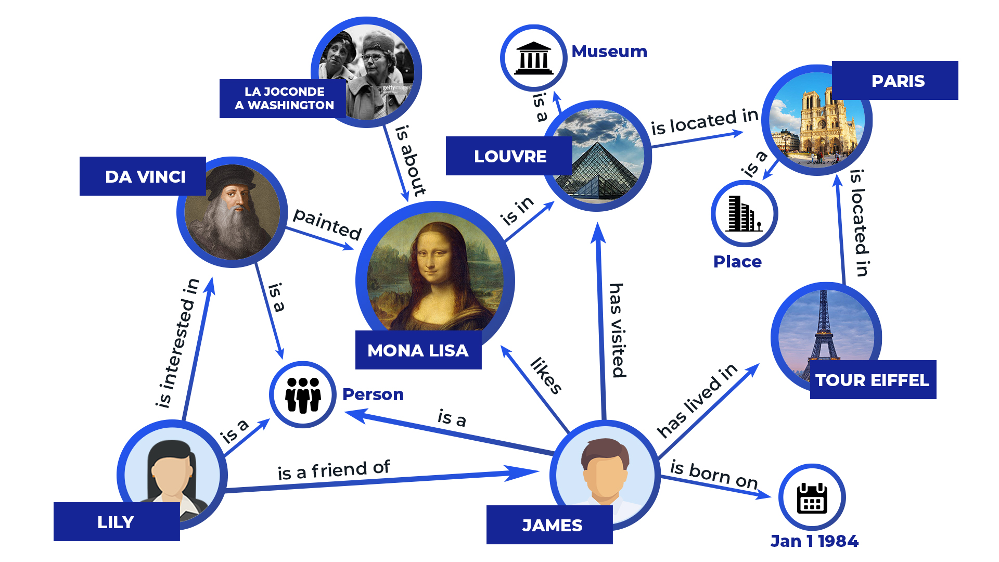

多模态知识图谱 (Knowledge Graph):构建“运动员-动作-伤病-战术”实体关系网。例如,通过图谱推理发现“某动作模式”与“前交叉韧带损伤”之间的潜在因果链条。

智能Agent编排 (Agent Orchestration):

自动化任务执行:以Agent为核心串联各类工具。例如,教练发出“分析A球员体能下降原因”指令,Agent自动调用“数据检索工具”、“对比分析脚本”和“报告生成器”,最终输出包含视频剪辑与图表的综合报告。

跨模态对齐:实现“行为 ↔ 文本”的双向映射。既支持用自然语言检索特定动作视频(如“查找所有正手失误片段”),也支持将动作数据转化为文字解说。

4. 具身执行与生成层 (Embodied & Generative Layer)

负责将数字世界的分析结果反哺物理世界,实现虚实交互。

AIGC动作生成:基于扩散模型(Diffusion Policy),根据文本指令或战术需求,生成符合物理规律的3D人体动作序列,用于虚拟人驱动或战术沙盘推演。

机器人控制映射:将运动员的“行为代码”映射为机器人的控制原语(Motor Primitives),支持人形机器人模仿学习人类的高难度体育动作,服务于智能陪练与物理辅助场景。

5. 跨层级核心能力 (Cross-Cutting Capabilities)

工程化边缘加速:支持TensorRT量化与异构计算优化,确保核心算法在Jetson AGX、高通骁龙等边缘芯片上实现低延迟(<30ms)、高帧率运行。

少样本自适应 (Few-Shot Adaptation):内置元学习模块,针对新动作(如新编排的武术套路)或新场景,仅需5-10个样本即可完成模型微调,极大降低定制化交付成本。

可解释性与溯源:所有的AI决策均保留“证据链”。大模型的每一条建议都能回溯到具体的视频帧、数据指标或知识库来源,解决AI“幻觉”问题,确保医疗与训练场景的安全性。

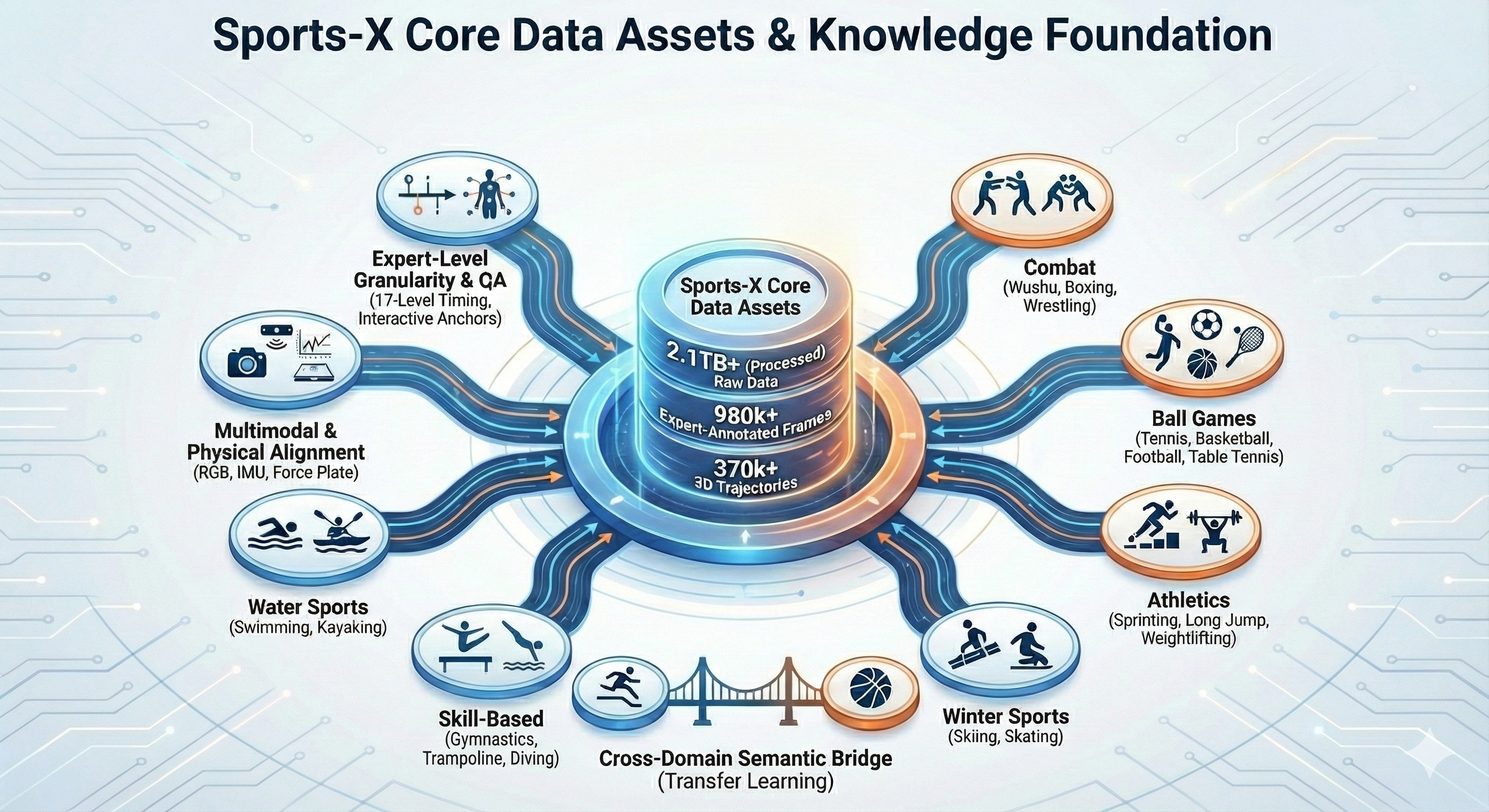

四、 核心数据资产与知识底座 (Core Data Assets & Knowledge Foundation)

人工智能的竞争本质上是数据的竞争。为了突破通用开源数据集在专业体育场景下的精度瓶颈,我们历时数年,构建了目前行业内规模最大、颗粒度最细、模态最全的竞技体育专属数据资产。这不仅是我们训练高精度模型的基础,更是本引擎不可复制的核心竞争壁垒(Data Moat)。

1. 行业级数据版图 (Industry-Scale Data Landscape)

我们将数据触角延伸至竞技体育的每一个角落,构建了覆盖 8 大类、42 个细分项目 的全景数据库,原始数据量超过 2.1TB(清洗后)。

全品类覆盖:

技巧类:体操、蹦床、跳水(强调空中姿态与翻腾计数)。

格斗类:武术散打、拳击、摔跤(强调多人交互与接触判定)。

球类:网球、篮球、足球、乒乓球(强调人-球-拍的三元关系)。

体能类:短跑、跳远、举重(强调爆发力与周期性运动学特征)。

特色项目:冬季运动(滑雪、滑冰)与水上项目(游泳、皮划艇)。

高密度标注:

已完成 98 万帧 关键动作的专家级标注。

提取并清洗了 37 万条 高精度三维关节点轨迹(3D Trajectories)。

2. 多模态与物理对齐 (Multimodal & Physical Alignment)

区别于仅有二维像素标签的普通数据集,我们着重构建了包含“物理真值”的多模态子集,为模型理解生物力学提供了“金标准”。

视觉-力学同步:包含大量同步采集的 RGB视频 + IMU惯性数据 + 测力台(Force Plate)数据。这使得模型能够学习从视觉图像反推地面反作用力(GRF)和关节力矩的隐式规律。

多视角几何约束:建立多摄像头同步子集,利用多视角几何一致性自动修正单目遮挡问题,大幅提升了3D重建算法在复杂遮挡下的鲁棒性。

3. 专家级颗粒度与语义体系 (Expert-Level Granularity)

我们拒绝粗糙的“黑盒”标注,而是为每个项目设计了符合行业规则的专属语义体系。

差异化标注标准:

武术/体操:标注精度细化至 17级时序细分(例如:将“旋风脚720°”拆解为起跳、腾空、旋转第一周、旋转第二周、落地等微阶段)。

对抗项目:特别标注了双人骨架的交互锚点(如擒拿时的抓握点、摔跤时的受力点)。

跨项目语义桥梁:

建立了通用的运动学特征映射(如角动量、质心位移、功率输出),打通了不同项目之间的壁垒。这意味着模型从“跳远”中学习到的下肢蹬伸发力模式,可以迁移(Transfer Learning)至“篮球扣篮”或“跳高”分析中,实现举一反三。

4. 严苛的质量控制流程 (Rigorous Quality Assurance)

为确保数据能够通过医疗与科研级的验收,我们实施了四级质量“清洗”机制:

初审(Candidate):由受过培训的专业标注团队进行预处理与初步打点。

复核(Double Check):资深标注师进行交叉验证,剔除明显误差。

专业审查(Professional Review):引入退役运动员或裁判员,对动作的起止点、技术名称进行规则级确认。

专家仲裁(Expert Arbitration):针对高难度的边缘案例(Hard Cases),由生物力学专家进行最终仲裁。

五、 行业解决方案与案例 (Industry Solutions & Case Studies)

基于核心引擎的全栈能力,我们构建了覆盖竞技体育、大众健身、医疗康复与内容制作的四大行业解决方案,并在多个垂直场景完成了从“技术验证”到“商业落地”的闭环。

1. 竞技体育:极致量化与战术博弈

面向职业队、赛事转播方与科研机构,提供毫秒级精度与战术级深度的分析系统。

案例A:智能跳远运动分析系统(单目 4K@160fps,高帧率、高分辨率)

目标:用单目高速视觉精确捕捉助跑、起跳、滞空与落地全过程,自动提取并计算 74 项运动学指标,为教练提供可操作的技术改进建议与训练处方。

架构:摄像头采集 → 视频预处理(去畸变/ROI/帧同步)→ 目标检测与跟踪 → 高精度 2D 姿态估计 → 关键帧(foot-strike / take-off / landing)捕捉 → 时空骨骼滤波与插值 → 运动学/动力学参数计算 → 报告与可视化(时序曲线、热力图、分步对比)。

关键技术点与实现细节:

相机与采样:单目 4K(3840×2160)@160fps;使用全局快门摄像头以避免滚动快门伪影。ROI 预先裁切以减小计算量,关键帧保持原始分辨率用于细节测量。

检测与跟踪:轻量人体检测器(裁剪到人身边界框),Fuse-Tracker 进行短时重识别,保证每次试跳身份稳定。

高精度 2D 姿态估计:姿态估计算法切换策略:平常训练/实时采用轻量框架(rtmpose/hrnet),关键帧使用高精度vitpose + 模糊去噪后处理。关键点数扩展(常规关节 + 足底接触点 +鞋跟/鞋尖标注)。

关键帧检测:融合骨架速度、角速度突变与光流能量的多模态判据检测 foot-strike、take-off、peak-height、landing。

时空滤波与无量纲归一:Kalman + 双向滤波,结合人体比例归一化(相对于身高或骨盆-颈距)以消除尺度问题。

运动学量算:基于关节位置计算关节角度、角速度、角加速度;使用逆动力学简化模型估计关节力矩与下肢功率(在无力台情况下为估计值,标注为“估计”)。

74 项指标体系:

助跑阶段(每一步):步长、步频、步态相位比、每步垂直 COM 峰值、踏地时间、支撑时间、摆动时间。

起跳 / 助蹬:跑速衔接角度、膝/踝伸展角速度(peak)、蹬伸速度(m/s)、起跳角、起跳点相对板边误差。

滞空/落地:重心最高点、飞行时间、落地冲击率、膝弯曲吸能时间。

对称性与稳定性指标:左右摆幅差、力量输出对比、单脚支撑稳定性。

关键帧图像级度量:基于高分辨率关键帧计算鞋面与跑道接触位置,结合畸变校正可达到 < ±2cm 的落板横向估计(视入射角与镜头畸变校正精度)。

自动报告:每次试跳自动生成单跳与分步报告(PDF + 可视化网页),包含:时间序列曲线、关键帧叠加图、74 指标表、训练建议(教练可自定义阈值模板)。

验收指标

关键事件定位误差 ≤ ±6 帧(160fps 下 ≈ ±0.0375s)

关节角度绝对误差 ≤ 3°(关键帧)

助跑步长测量误差 ≤ ±3%(对比激光测距或地面标尺)

系统端到端延迟(实时模式) ≤ 200ms(含渲染)

核心创新点

单目高帧率下的精细脚步分辨方案:通过足部多关键点+光流联合判据实现逐步步态断点检测,而非仅用速度阈值。

运动学指标可追溯性:所有指标都可回溯到“原始关节点-关键帧”,便于教练图像驱动教学。

事件级关键帧分割与分析引擎:自动识别“技术瞬间”并给出具体可量化指标(非模糊建议)。

案例B:网球技术战术量化分析系统(多目姿态 + 球轨迹 + 战术层)

目标:对比赛/训练中双方球员与球的时空关系、技战术动作做高精度量化与可视化,为教练提供战术洞察与技术优化建议。

架构:多目摄像头(场边与天顶)同步采集 → 人球检测与跟踪 → 双人姿态估计(时序关联)→ 网球 3D 轨迹重建(弹道拟合 + 旋转估计)→ 细粒度动作识别(击球类型)→ 落点/出界/擦网判断 → 战术模块(线路热力、得分模式、回合构成)。

关键技术与实现细节:

多目同步与标定:使用硬件帧同步(PTP 或 genlock)或时间戳校准;场景标定采用地面标尺+线段自动检测提升线识别精度。摄像头布置兼顾覆盖与冗余(两侧 + 高位)。

人球联合跟踪:球体小且快速,采用两阶段策略:帧间高感度球检测(基于小目标增强的 YOLO / RetinaNet),结合卡尔曼与多模型运动学(匀加速+抛物轨迹)做短期补帧。对遮挡(网、球员)采用轨迹补全与概率采样。

网球旋转估计:在高分辨率视角下,利用球表纹理与时序子像素偏移估计旋转轴与转速(结合光流与表面纹理模板匹配)。旋转信息可用于区分上旋/下旋/侧旋。

姿态与动作识别:双方姿态序列输入骨架 + 图像补充(球拍局部patch)到多分支网络 → 图卷积与时间序列混合模型对细粒度击球类别做分类(正手、反手、切削、高压、截击、发球等)。球拍角度与拍面速度从手腕、肘、肩轨迹估算并与球点时间对齐。

落点判断与球场线识别:线检测采用 Hough + 神经网络细化;基于多视角三角测量求出球落点并判定是否落在界内;对擦网、擦边利用高速连帧与深度提示判断接触瞬间。

战术引擎:基于回合分割得到发球方/接发方序列,构建回合级事件图(节点:击球类型、落点、得分结果),应用图统计或图神经网络识别常见战术模式(如“发球上网成功率”、“底线拉锯得分率”)。

验收指标

球落点定位误差 ≤ 10cm(在覆盖视角良好情形)

击球类型准确率 ≥ 94%(细粒度分类)

旋转分类(上/侧/下)准确率 ≥ 90%(在高分辨率角度)

系统延迟(回合结束生成初步战术报告) ≤ 5s(离线回放模式可即时)

核心差异化/创新

人—球耦合识别:将球拍局部 patch 与骨架融合而非纯骨架输入,极大提升短时动作区分能力(如切削 vs 平击)。

回合图谱化:把比赛转化为图数据结构,能做跨比赛的战术模式挖掘(可用于对手画像)。

旋转可视化:不仅分类旋转,还给出旋转轴方向与估计转速,辅助教练调整技术细节(如上旋峰值时刻与拍面角关系)。

案例C:高精度武术套路难度动作识别系统(FineWushu 数据集)

目标:实现武术套路中极细粒度动作识别与高准确率评分,支撑评分、裁判辅助与训练分析。

核心技术

三阶段框架:YOLOX(目标检测)→ ViTPose(高精度 2D 关键点)→ PoseC3D+CBAM(时空骨架 + 通道注意力)识别 → 量化评估。

FineWushu 数据集:从零构建、总量 196GB,细粒度标签到 17 关键点时序细分(例如 旋风脚 720° 单独分段),含多光照、复杂背景与多人场景。

时序增强:在 PoseC3D 中引入 CBAM 模块后增强空间/通道注意力,专门强化极短时动态特征(如翻腾瞬间)对判别的贡献。

训练策略:结合对比学习提升类内差异性判别、使用时序数据增强(速度缩放、随机丢帧)来提升对节奏变化的鲁棒性。

性能与工程细节

识别准确率:在独立测试集上 99.84%,并且在多视角下保持较高稳定性(多摄像头投票机制)。

可解释性:输出每个识别结果的关键帧热力图(显示哪些关节点为判别依据),便于裁判审查与训练修正。

实时/离线模式:离线用于正式评分与录像回放,实时用于训练纠正与动作提醒(有一定延时容忍)。

创新点与价值

大规模细粒度数据集(FineWushu)为模型泛化奠基,解决动作内差异大问题。

Attention-enhanced PoseC3D:在复杂动作分离上更有辨识力,特别对高难度空翻与多轴旋转动作效果显著。

裁判辅助工具:能把黑匣子化的判定用可视化证据(关键帧/关节角度/着地点)解释。

案例 D:武术·散打战术与动作预测系统(skeleton + RGB 多模态架构)

目标:面向比赛与训练的散打智能系统,完成帧级动作识别、段落/回合级战术解析、短时动作/意图预测与裁判判罚辅助。系统基于骨架(skeleton)提供精确运动学量化、RGB 提供接触/受力/裁判语义信息,两者互补以满足竞技场景对实时性、鲁棒性与可解释性的严格要求。最终输出包括动作-事件流、下一步动作概率分布、战术评分与裁判建议(例如有效击中/犯规提示)。

##

核心技术

目标检测与稳健跟踪(ID persistence): 人体检测(person)+ 裁判/医护/裁判手势识别,结合 ReID + motion affinity 保证长回合中双方 ID 的稳定性,避免裁判/换人、遮挡导致的 ID 跳变,确保战术时序归属正确。

2D→3D 相对重建(以躯干/骨盆尺度归一): 单目或多摄重建出相对尺度的三维关键点(骨架),并生成关节速度、角加速度、质心(COM)轨迹及近似冲量/位移指标,为 kinematic proxy(如打击瞬时位移、摔投冲量估计)提供输入。

动作分段与技术栈识别(帧级→段落级): 基于帧级 skeleton features 与 RGB patch context,采用分层定位框架(类似ActionFormer / BMN 风格)实现以下细粒度动作识别:

抱摔类(Takedown / Throw):抓握→牵引→翻转→落地四段分割与接触判定;

出腿/腿击(Kick):前踢、侧踢、旋转踢的起腿角度与接触窗检测;

拳打/手击(Strike):刺拳、摆拳、勾拳的出拳时序与命中判定;

摔法(Sweep / Trip):低位扫腿/绊倒动作的施力时窗与成功判定;

摔抱结合/悬绷(Clinch & Throw combos):近身抱摔与转体投掷的复合段落识别;

裁判判罚相关事件:命中头部/犯规抓掐/倒地停战/离场等。

skeleton + RGB 多模态融合: Skeleton 提供高精度几何与动力学特征(角度、速度、相对位置),RGB 补充接触细节(手套接触、面部表情、裁判手势、边线视觉证据)。采用 cross-attention 融合层或 late-fusion ensembling:短时内以 skeleton 为主、RGB 为辅助(接触 /受力证据);长时序用于战术模式识别时两路并重。

动作/意图短期预测: 基于 ST-GCN/Temporal Transformer 的预测头输出下一 0.5–2.0 秒内的动作概率分布(predictive horizon 可配置),并给出置信区间与可决策阈值(例如在置信 > 0.85 时触发裁判提示或训练实时提示)。

战术序列化与策略分析: 把动作流压缩为离散“行为代码”后,进行 n-gram / Markov / sequence mining 与 motif detection,识别常见连招、弱点触发条件与对手针对性战术(如“对方后退→左腿扫→反击连击”模式),生成可执行训练处方与对手剖析报告。

裁判判罚与安全预警模块: 通过 RGB 检测的接触热区 + skeleton 的相对速度/距离代理估算冲击强度,结合规则引擎(判罚规则库)输出“可能有效命中 / 可能犯规 / 可能危险摔落”的候选事件并标注证据帧,供裁判回放与人工判定。

异常与伤害风险识别: 利用自编码器或基于残差的异常评分,对比运动员常模(历史 skeleton 分布)检测异常动作模式(非惯常落地、关节过伸),并在高风险事件发生后自动生成康复/检查建议(例如可疑膝前交叉应复核)。

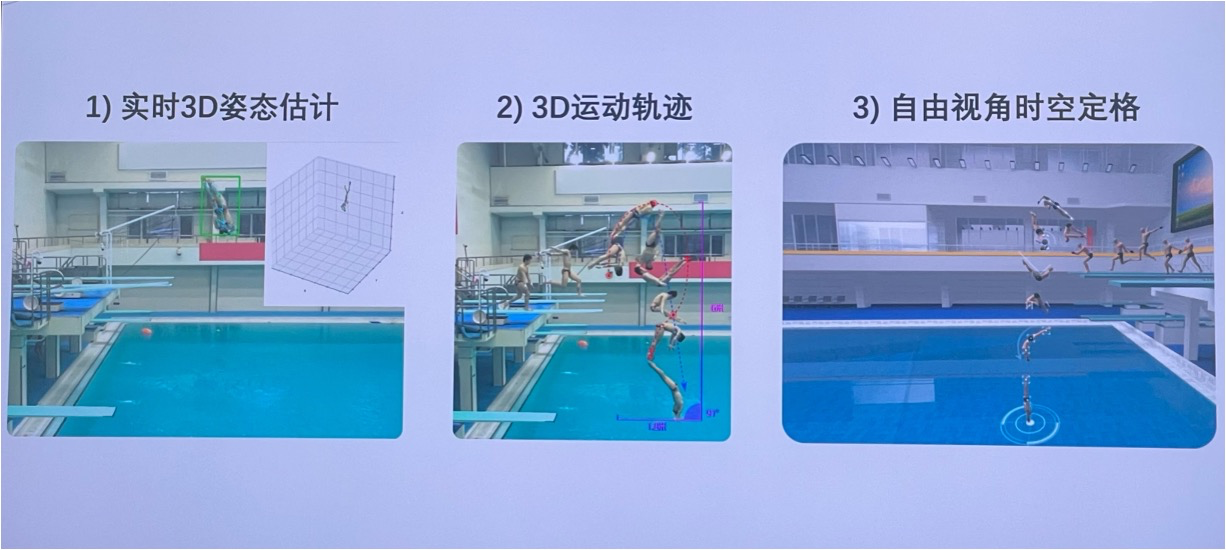

案例E:跳水运动动作分析工具箱(实时 3D 姿态、自由视角)

目标:为跳水提供实时 3D 姿态重建、轨迹重建与自由视角时空定格,支持动作评分、完美落水判定与训练回放。

关键技术

多摄像头高帧率同步(推荐 240fps 或更高,低帧率难以捕捉翻转周期)。

无标记 3D 重建:使用多视角稠密关键点匹配 + 时间一致性约束重建 3D 姿态(针对空翻期间的高速自旋采用惯性补偿策略)。

自由视角渲染:重建三维网格/骨骼后生成任意视角渲染与慢动作重放(并可合成极慢的逐帧动画用于教学)。

评分辅助:自动计算翻转次数、翻转速率、身体折叠角度、入水瞬间姿态(垂直度误差、进入水中角度)等关键评分指标。

创新点

自旋角动量保持检测:估计选手在翻转时的角动量分布,以检测是否存在动作节律上的漏洞。

水花估计辅助:在入水后结合高帧率下方摄像头估计水花大小(作为入水质量的辅助证据)。

2. 大众健身与体育教育:AI 智能教练

面向连锁场馆、校园体育与家庭场景,提供可规模化复制的标准化教学与评分工具。

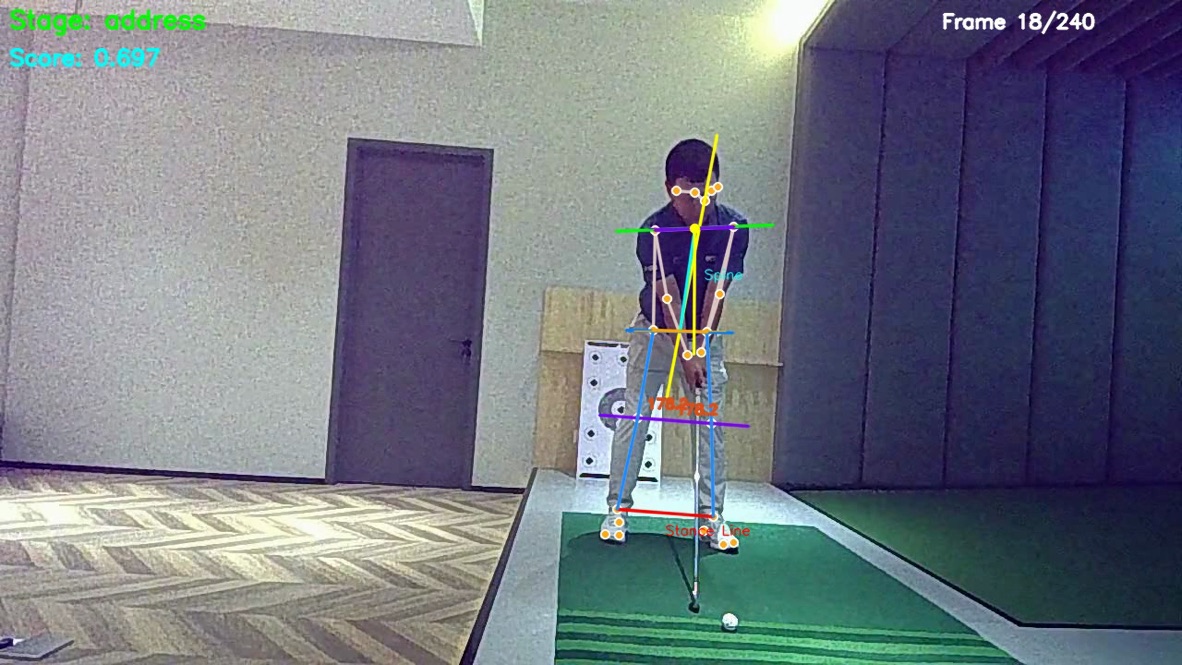

案例F:高尔夫智能 AI 教练(双目 1080p@120fps,同步、毫米级标定)

架构:双路 1080P@120fps、张正友标定、职业样本库 1500+标准动作库、rtmdet + rtmpose 实时定位(10ms/帧)、motionBERT 3D 姿态(MPJPE 6.2px@1080P)、八阶段挥杆分割、动作阶段识别 98.7%、27 项量化指标。

关键技术点

双目标定精度控制:采用张正友棋盘格多视角标定 + 非线性重投影优化(bundle adjustment),并在场地内放置 3 个标定点做持续标定监测,达到重投影误差 < 1px。

实时人机估计链路:RTMDet(检测)→ RTMPose(2D)→ 双目三角并行至 3D 初估→ motionBERT 用时序上下文校正 3D(用于消除单帧噪声与尺度抖动)。

八阶段分割:预定义阶段:Address → Toe-up → Mid-backswing → Top → Mid-downswing → Impact → Mid-follow-through → Finish。基于 LSTM 模型 融合杆头速度/重心/扭矩特征进行分割与阶段滚动判定。

多模态评估引擎:

时间对齐采用 DTW 做关节轨迹匹配;

运动学偏差计算(髋旋转角误差等)基于空间刚体变换对齐;

可视化输出包括三维差异热力图、杆头速度曲线、节段建议。

动作图谱库:职业样本库 1500+ 动作均经专家标注(阶段边界、关键瞬间、评分标签),建立多尺度聚类与检索索引,供相似动作检索与对比。

性能优化:核心推理部署使用 TensorRT / ONNXRuntime,双目同步后端做并行计算以保证 ≤10ms/帧(仅检测+2D推理),完整链路延迟在 60–120ms 之间取决于是否启用 motionBERT 上下文校正。

指标与交付

精度:MPJPE 6.2px(1080p),阶段识别准确率 98.7%(内部验证)。

报告:27 项指标(包括杆面角、杆头峰值速度、髋旋转角、肩旋转角、下肢功率占比等),并给出训练建议与练习模块。

交付物:实时教练端 UI、服役级边缘箱(双摄同步模块)、职业动作库接口、离线分析工具。

差异化与创新

毫米级双目对齐:在消费级视觉系统中实现近专业测量精度,利于高端俱乐部与教学机构使用。

stage-aware feedback:按挥杆阶段给出细粒度训练建议,而不仅是事后评分。

可扩展性:动作库可动态扩容并支持在线学习(在获得授权数据后可做增量微调)。

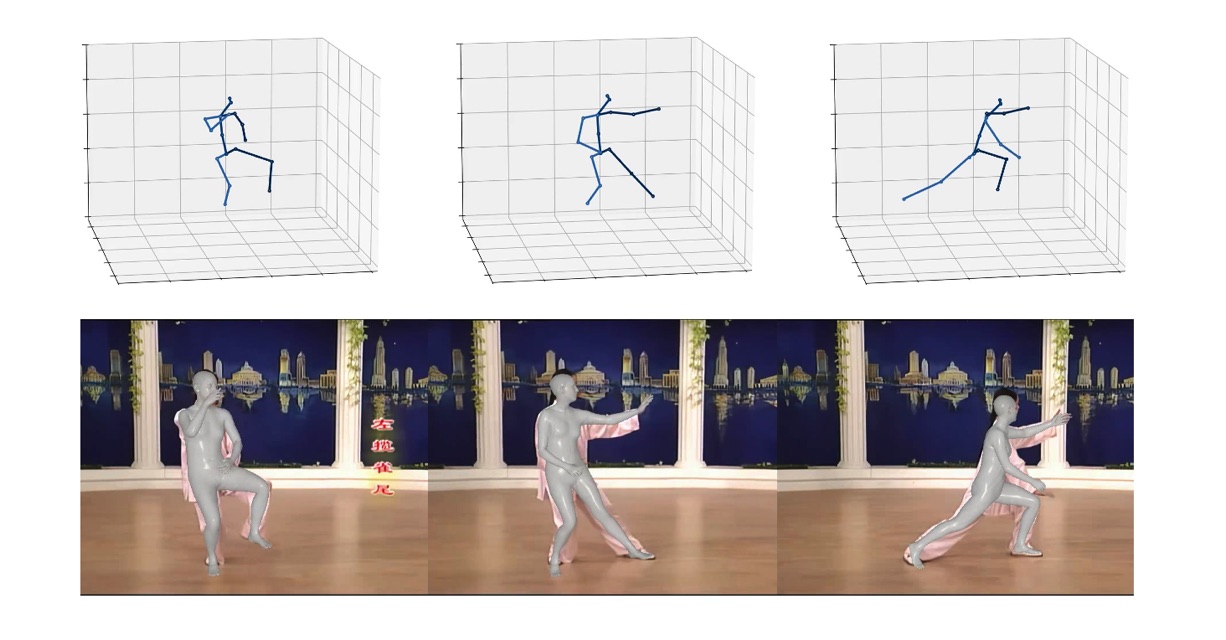

案例G:太极拳动作分析对比评估系统(套路分段与对齐)

目标:为太极拳提供段落级动作分割、3D 重建(相对尺度)、细粒度对齐与训练建议,兼顾美学与功能性评估。

流程与技术亮点

目标检测与稳定身份跟踪:保证长序列中人体 ID 的稳定性,避免重置导致的对齐错位。

2D → 3D 转换:单目重建输出“相对尺度”骨骼轨迹(以骨盆或身高归一),与标准动作做 DTW 对齐。

动作分段:把套路切分为“二十四式”或更细的子段(可配置),分段依据动作模版匹配、关节角速度变化、连续关节约束与动作语义模板。

对齐与误差定位:帧对帧相似度热图、偏差热区截图、左右对称性分析、关节角度误差分布并生成训练建议(例如肩外展不足建议的具体练习)。

平衡与稳定性分析:估算 COM 横向偏移(相对身高比例),给出平衡训练处方。

可视化:热力图、误差直方图、时间对齐甘特图、建议清单。

工程化交付

能生成分段级别的对齐报告并附带“动作修正清单”(分为呼吸、节奏、关节角度三类建议)。

支持教师/教练端的“逐帧对比”交互界面,便于口令式教学和动作精修。

3. 跨界赋能:医疗康复与内容创作

面向医院、康复中心及影视游戏开发商,提供专业工具与数据底座。

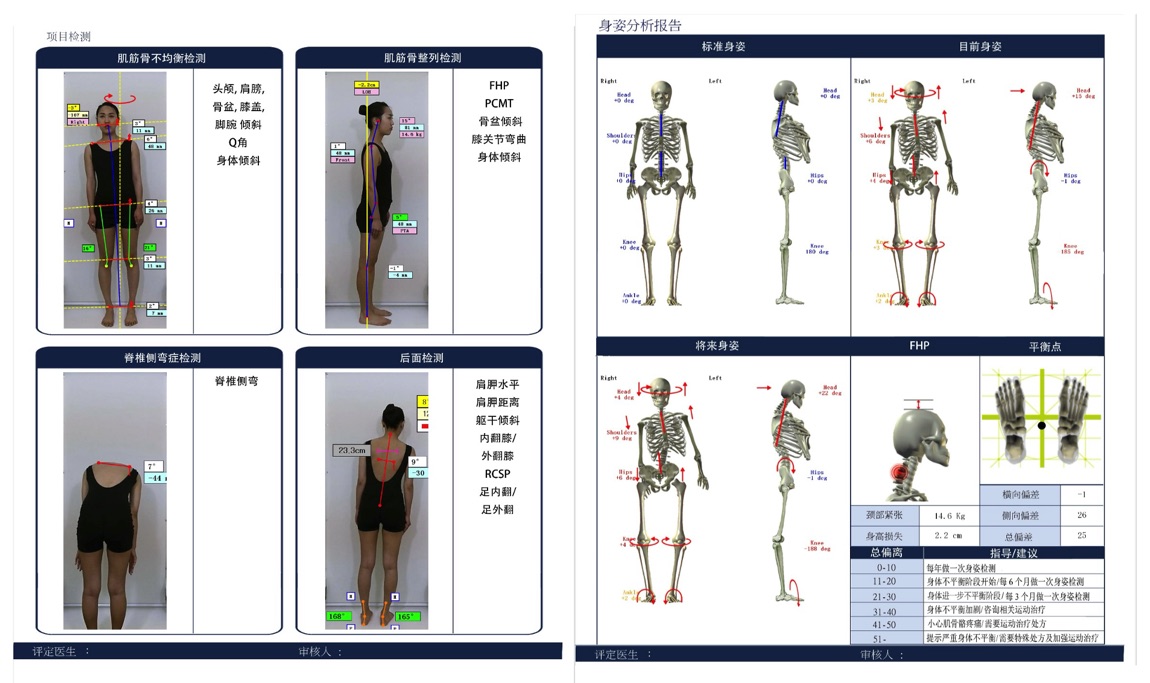

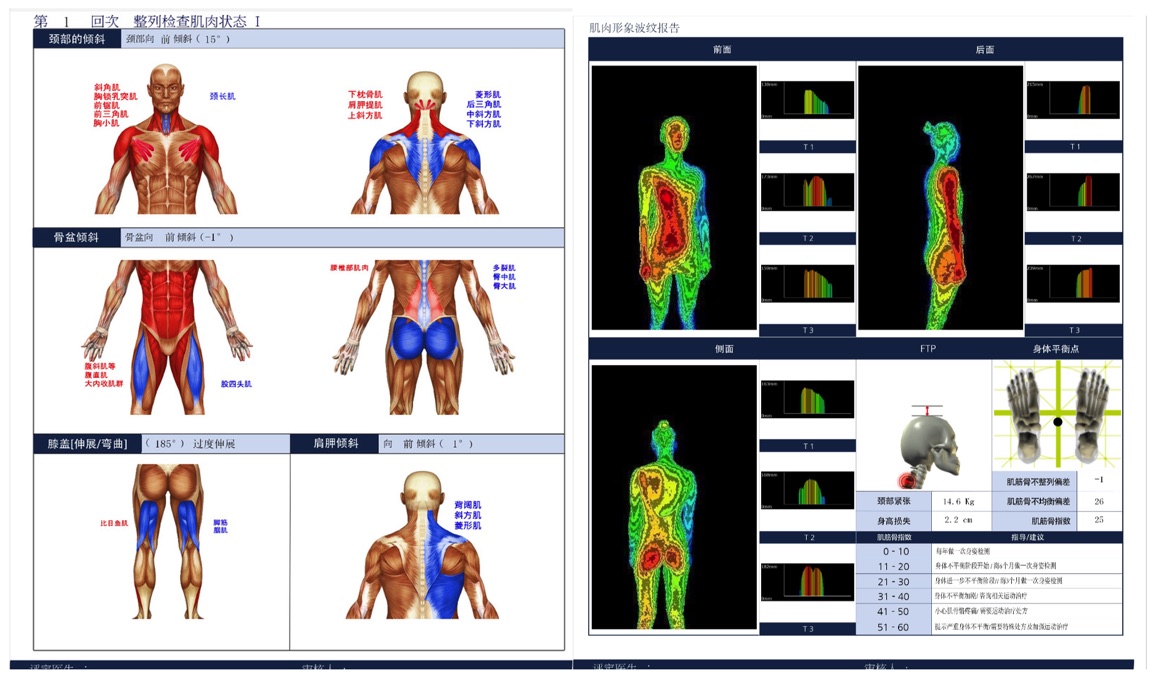

案例H:静态体姿评估系统(多角度、多维度)

目标:为医疗/康复/体能评估提供一套非接触式、可重复、可量化的体姿与肌骨健康评估工具箱,涵盖静态与慢速动态姿势。

功能清单:

自动识别 25 个关节点与肌肉群显示。

关节活动范围(ROM)自动化输出、肌肉紧张度估计(基于纹理 & 姿态偏移的代理量)。

脊柱曲度与侧弯曲线可视化(结合侧面/正面多视角重建)。

专项测试:亚当测试(脊柱旋转)、FHP、PCMT、Q 角分析等。

足部纵横弓与内外翻判定,骨盆倾斜角度精确测量。

综合评分与偏差定位(具备分部截图 + 标注式建议)。

关键技术点

多角度采集:正侧背三视角摄像头(最低 2 台深度或结构光相机可选),保证脊柱与骨盆的 3D 重建精度。

带纹理分析的肌肉紧张度估计:通过高分辨率正面图的皮肤表面细微纹理与实时肌肉形变(与静态姿势模板差异)估计可能的肌肉痉挛/紧张迹象(作为提示而非医学诊断)。

脊柱与骨盆建模:侧面视角拟合脊柱曲线(Cobb 角近似输出),采用多视角 2D 关键点映射到拟合的脊柱中轴线并输出曲率、倾斜与侧弯度。

关节 ROM:通过受控动作(如患者抬臂到极限)拍摄,自动测量运动幅度并与年龄/性别/同类群体建立统计基线。

标准化评分体系:结合 FHP、Q-angle、骨盆倾斜、肩高差等多项指标融合生成“姿态健康分”,并输出以图示方式标注的偏差热区。

验收与合规

关节 ROM 估计误差 ≤ ±5°(对比 goniometer)

Cobb 角估计误差 ≤ ±3°(与医学影像参考)

提示性质的“肌肉紧张度”仅作为辅助指标,并在报告显著标注不是临床诊断

创新点

多维度融合:把纯视觉的关节角度测量和纹理/形态学指标结合,提供更丰富的“肌肉状态代理量”。

临床友好输出:直接生成可嵌入电子病历的结构化报告(含时序趋势),便于随访与疗效评估。

可配置的医疗级审查流程:默认“提示—复核—记录”流程,保证医疗合规。

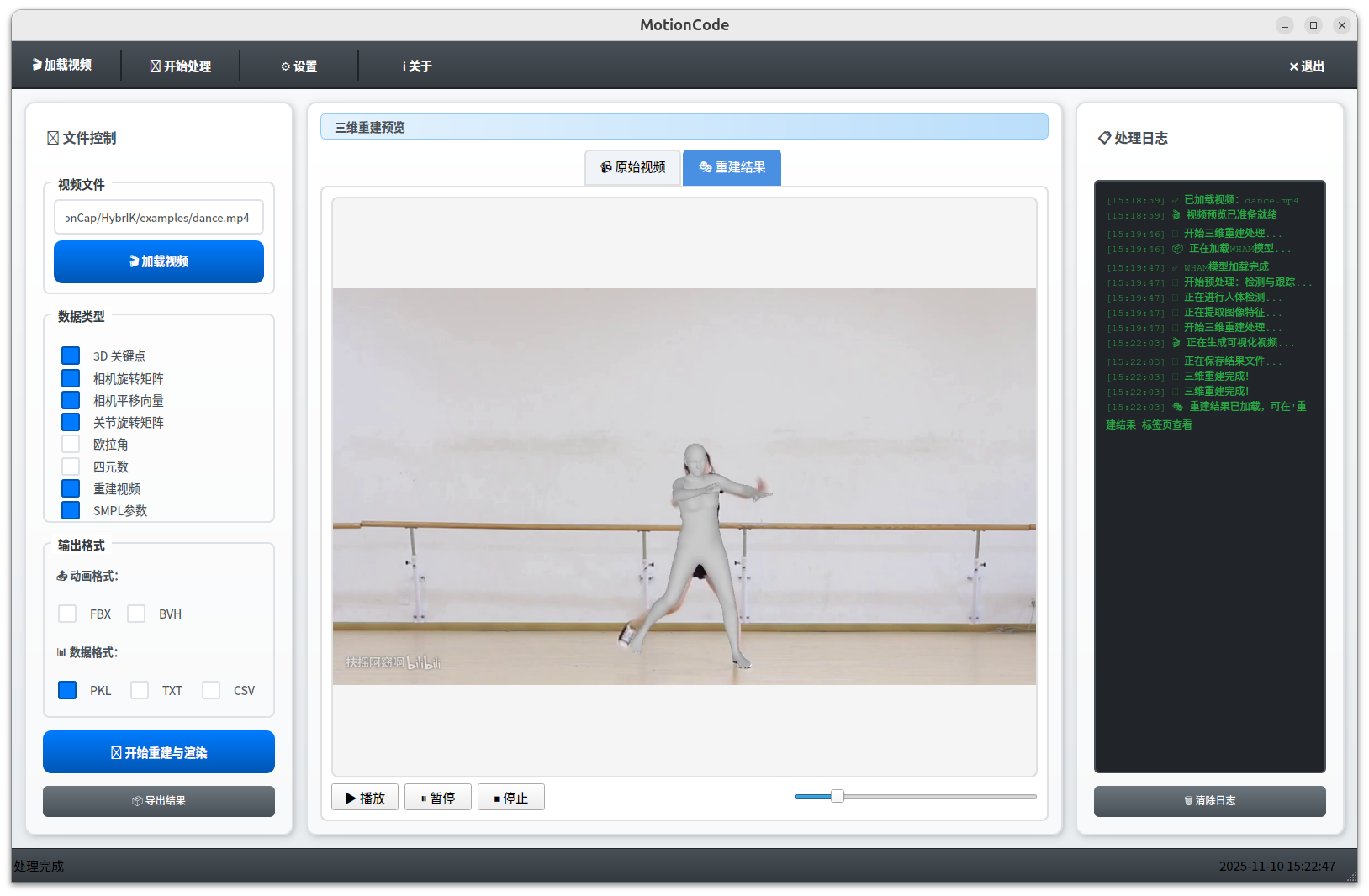

案例 I:单目视觉动作捕捉 App(可导出 FBX / BVH / PKL / Mesh 视频)

目标:用单台相机捕捉高保真三维人体动作并导出标准动画与数据格式,便于与 Blender、Maya 等三维建模/动画软件无缝对接,实现从实拍到可编辑动画的高效流水线。

流程与技术亮点

视频预处理:单目视频去畸变、人体检测与帧级关键点估计,产生鲁棒的 2D 关键点序列与置信度。

时序三维回归:基于短时序窗口的时序回归网络恢复相对尺度的 3D 骨架轨迹,结合先验人体运动库与运动学正则化抑制抖动与深度翻转。

轨迹优化与骨骼约束:对初步回归结果施加逆/正运动学约束(骨长一致性、关节极限、接触稳定性),输出可驱动动画的稳定骨架曲线。

网格重建与皮肤绑定:生成带重建网格的短视频(带纹理投影可选),并将骨骼权重映射到标准绑定(T-pose 校正),实现一键皮肤绑定导出。

多格式导出:直接导出 FBX(带骨骼与蒙皮)、BVH(骨骼运动)、PKL(原始关键点/骨架序列)与 mesh 视频(MP4/GLTF)供后续编辑、渲染与物理模拟使用。

Blender 对接注意点:提供标准骨骼命名与映射表、T-pose 校准脚本与批量导入示例,保证动作在目标软件上零或极少手工调整。

性能与可用性:支持离线批处理与近实时模式(GPU 加速);提供置信度带与误差提示,便于动画师或技术导演选择需人工校正的片段。

落地价值:将普通视频直接转为可编辑的三维动画资产,显著降低动作捕捉设备门槛,适用于运动动作分析、教学演示、影视/游戏动作原型与快速可视化。

六、 商业交付与部署 (Commercial Delivery & Deployment)

为了适应从顶级赛事现场到大众家庭客厅的差异化需求,我们设计了极具弹性的“云—边—端”一体化交付体系。无论是需要极致算力的科研机构,还是对成本敏感的消费级应用,都能找到匹配的接入方案。

1. 多样化交付模式 (Flexible Delivery Models)

边缘计算一体机 (Edge AI Appliance) —— 面向场馆与专业队

形态:软硬一体化工作站(基于NVIDIA Jetson AGX Orin或IPC工控机)。

能力:支持本地化部署,无需外网即可在局域网内完成多路4K视频的采集、推理与大屏渲染。

优势:零数据外泄、毫秒级低延迟(端到端 < 100ms),保障比赛现场战术分析的时效性。

企业级 SaaS 平台 (Enterprise Cloud SaaS) —— 面向青训与赛事运营

形态:基于Web的分析管理平台。

能力:用户上传比赛视频,云端(A100集群)进行离线深度分析,生成战术报告与精彩集锦。

优势:零硬件投入,按量付费(Pay-as-you-go),支持历史数据的长期存储与横向挖掘。

嵌入式 SDK 与 API (Embedded SDK & API) —— 面向硬件厂商与APP开发者

形态:轻量化推理库(.so / .dll)与RESTful API。

能力:提供移动端(iOS/Android)与PC端算法包,支持高通骁龙(Snapdragon)、联发科及NPU加速。

优势:极小的包体积(Lite版模型 < 10MB),赋能智能健身镜、AR眼镜及运动APP具备“视觉感知”能力。

2. 广泛的硬件兼容性 (Hardware Agnosticism)

我们坚持“算法定义硬件”的理念,解耦了对昂贵专用设备的依赖。

摄像设备:

专业级:全面兼容 Sony/Basler 等工业高速相机(通过GenICam接口),支持多目硬件帧同步。

消费级:适配普通网络摄像头(Webcam)、手机摄像头甚至无人机航拍视角。

多传感器融合:

原生支持 Vicon/OptiTrack 光学动捕系统的数据对齐。

提供蓝牙接口,无缝连接 Polar(心率)、Xsens(IMU)及主流国产测力台。

3. 开发者生态支持 (Developer Ecosystem)

跨平台引擎插件:提供官方 Unity 3D 与 Unreal Engine 插件,支持将实时解算的骨骼数据直接驱动数字人(Avatar),无需中间件转换,加速体育元宇宙与游戏开发。

标准化数据接口:输出数据遵循 JSON / BVH / FBX 标准格式,方便对接 Excel、Matlab、OpenSim 等第三方分析软件。

七、 合规与安全 (Compliance & Security)

在处理人体生物特征与医疗健康数据时,我们将“隐私保护”置于技术架构的最顶层。本引擎严格遵循全球数据合规标准,构建了金融级的安全防护体系。

1. 隐私优先架构 (Privacy-First Architecture)

“计算即销毁”策略:在边缘计算模式下,视频流仅在内存中进行特征提取,原始视频图像不落地存储,仅保留脱敏后的骨架数据(Skeleton Data)与行为代码。

生物特征去标识化:在云端分析场景中,系统自动对人脸进行模糊化处理(Face Blurring),并剥离身份信息(PII),确保用于训练或分析的数据无法溯源至具体个人。

2. 医疗级数据合规 (Medical-Grade Compliance)

互操作性标准:系统支持 HL7 FHIR 标准接口,能够无缝对接医院的 PACS(影像归档和通信系统)与 EMR(电子病历)系统,确保康复评估报告能直接合规地进入医疗流程。

本地化隔离部署:针对医院与科研院所,支持完全断网的本地服务器部署(On-Premise),杜绝敏感病患数据出院的风险。

HIPAA & GDPR 准备:架构设计完全符合美国 HIPAA(健康保险流通与责任法案)与欧盟 GDPR(通用数据保护条例)的要求,支持数据跨境传输的合规性审查。

3. 企业级安全治理 (Enterprise Security Governance)

全链路加密:数据传输采用 TLS 1.3 协议,存储采用 AES-256 加密标准。

细粒度权限控制 (RBAC):支持基于角色的访问控制,严格区分教练、队医、运动员与管理员的数据查看权限。

审计与溯源:所有系统操作(包括数据查看、导出、修改)均生成不可篡改的审计日志(Audit Logs),满足职业体育赛事与医疗事故鉴定的追溯需求。

八、 未来演进路线 (Product Evolution Roadmap)

我们的愿景是构建一个不仅能“看懂”现在,更能“推演”未来的数字体育世界。基于 Sports-MLLM(体育垂类多模态大模型) 的持续迭代,我们将沿着以下三个维度推进下一代引擎的演进:

1. 物理维度的深化:纯视觉动力学透视 (Visual-Force Physics Engine)

从“看动作”进化到“看力量”。

目前的视觉技术主要解决运动学(Kinematics)问题(如关节角度、速度)。下一代引擎将集成基于物理的推理模块(Physics-based Inference),实现从视频像素直接推断人体内部动力学参数。

隐式力学感知:无需昂贵的测力台,模型即可根据肌肉形变与骨骼微动,估算每一帧的关节力矩(Joint Torque)与地面反作用力(GRF)。

应用场景:这将彻底改变康复医学与体能训练,使得在普通健身房甚至户外环境中,进行精密的ACL(前交叉韧带)负荷监控与骨骼应力分析成为可能。

2. 时间维度的延伸:因果推理与预测性防护 (Causal Inference & Predictive Sentinel)

从“事后诊断”进化到“事前预警”。

我们将超越传统的相关性分析,赋予AI因果推理(Causal Reasoning)能力,构建个性化的损伤风险预测模型。

多模态风险归因:综合分析运动员的长期训练负荷(外部数据)、近期生物力学压力(IMU数据)与实时动作模式(视觉数据)。系统将不再只报告“他受伤了”,而是预警“基于当前右侧落地峰值力增加30%且伴随膝外翻,未来一周内发生应力性骨折的概率极高”。

主动式健康干预:从被动的“康复治疗”转向主动的“损伤预防(Pre-hab)”,动态调整训练强度建议。

3. 认知维度的突破:多智能体博弈与反事实推演 (Multi-Agent Sandbox & Counterfactual Reasoning)

从“单体分析”进化到“群体博弈”。

针对足球、篮球等复杂团体项目,我们将引入多智能体(Multi-Agent)仿真系统,将场上球员建模为具有独立决策能力的Agent。

反事实战术推演:这是战术分析的终极形态。系统将能回答“如果……”的问题。例如:“如果在第75分钟,球员A选择传球给B而不是射门,进球概率是否会提升?”

动态沙盘模拟:教练可以在数字孪生沙盘中预演不同战术阵型,AI将模拟对手可能的应对策略(Counter-tactics),辅助教练在赛前制定最优博弈策略。

4. 交互维度的升维:具备“思维链”的共情教练 (Empathic AI Coach with CoT)

从“冷冰冰的打分”进化到“有温度的指导”。

利用多模态思维链(Multimodal Chain-of-Thought)技术,大幅提升AI的可解释性与交互体验。

逻辑化反馈:AI将不再只是输出一个“65分”,而是像人类专家一样层层剖析:“首先,你的起跳高度足够;但是,在滞空最高点你的核心肌群过早放松;导致落地时膝盖承受了多余的剪切力。因此,建议先进行核心抗旋训练。”

情感化激励:根据用户的疲劳度与情绪状态(面部表情/语音语调),动态调整指导口吻,提供兼具专业度与鼓励性的陪伴式教学。